unmodern talking's Public Feed: One in a Million (Extended Rem...

One in a Million (Extended Remix)

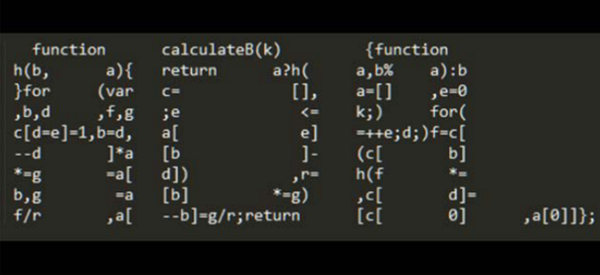

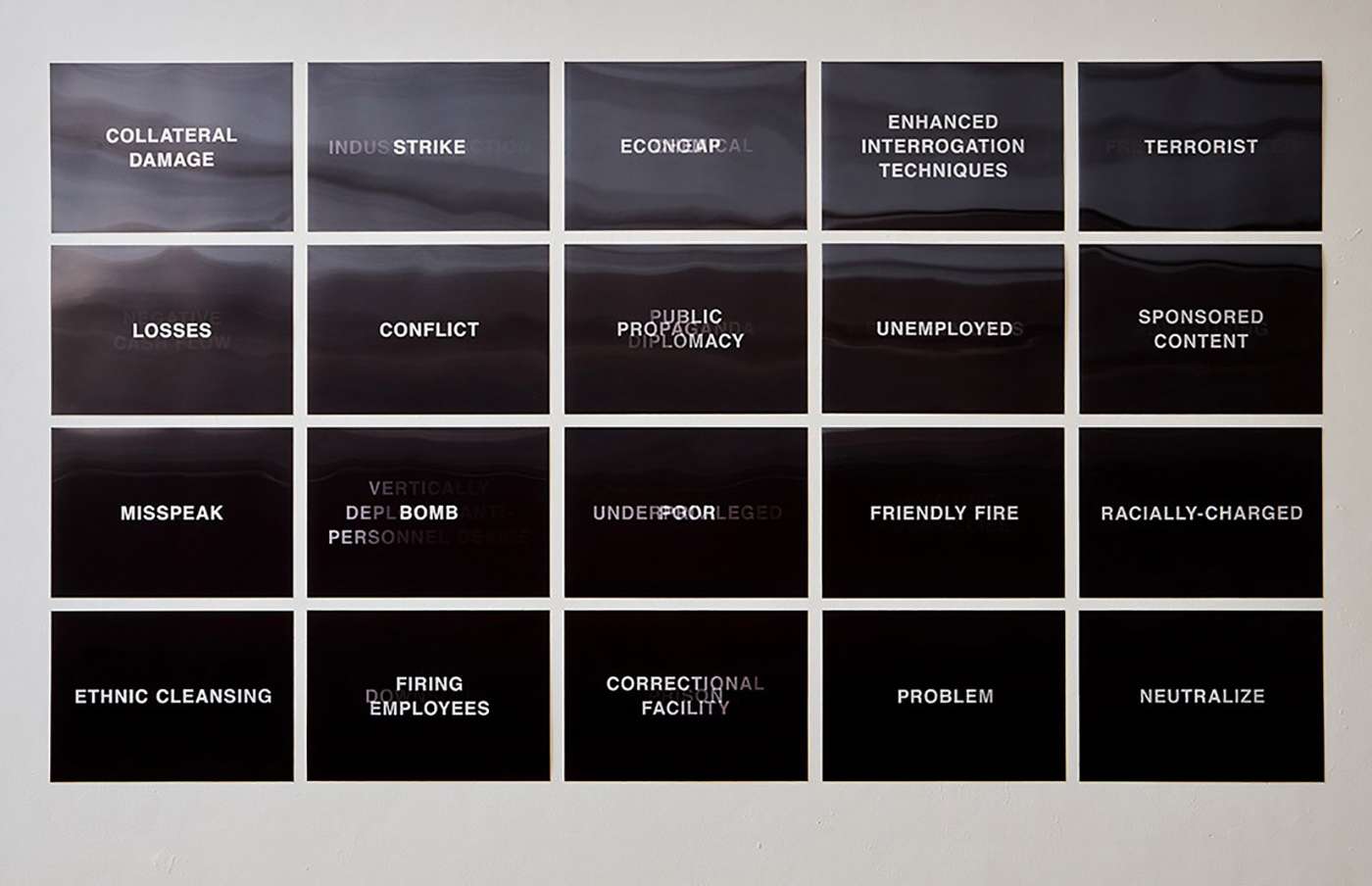

Spätestens mit dem Skandal um Cambridge Analytica haben Algorithmen im kollektiven Bewusstsein ihr abstraktes Dasein im virtuellen Raum verlassen und als machtvolle, materielle, körperliche und wahrhaftige Realität spürbar geworden. Es spielt keine Rolle, wer sich auf sozialen Plattformen bewegte, wer aktiv content bereitstellte, wer „nur“ konsumierte, wer überhaupt gerade mal eine Email-Adresse hat oder wer dem Internet noch gar nicht aktiv begegnet ist – alle mussten sich der Realität stellen, in der Donald Trump Präsident der Vereinigten Staaten war, in der Großbritannien aus der EU ausstieg, in der mehr als 100 politische Kampagnen auf fünf Kontinenten manipuliert und Menschen gezielt fehlgeleitet wurden. Mehr als Vehikel harmlos erscheinender „alternative facts“, wurden Algorithmen hier zu gewaltvollen Propagandamaschinen. Wie konnte das dem ach so demokratischen Westen durch die Lappen gehen? Und zwar gerade im ach so demokratischen Raum des Internets? Im Oktober letzten Jahres fand im Karlsruher ZKM die Konferenz „Herrschaft der Algorithmen“ statt. In diesem Rahmen hielt die Gründerin und ausführende Direktorin der Ethical Tech Society, Lorena Jaume-Palasi, ihren Vortrag mit dem Titel „Soziale Diskriminierung in algorithmischen Systemen“ und setzt sich mit der sozialen Beschaffenheit dieser Künstlicher Intelligenzen auseinander. Dabei betont sie gleich zu Beginn, dass die „künstliche Intelligenz“ als solche nichts anderes als ein kulturelles Konstrukt ist, das tief in westlich-kapitalistische Vorstellungen von Intelligenz im Allgemeinen blicken lässt – das intelligente Handeln der KI ist kein autonomes Denken, sondern ein absichtsloser Automatisierungsprozess; genau hier soll auch die Chance zur Assistenz in der sozialen und wirtschaftlichen Interaktion mit dem Menschen liegen. Das ist schon einmal ein Kernpunkt ihres Vortrages: Algorithmen mögen zwar wie ein Stück Technik erscheinen, sind aber de facto soziotechnische Systeme. Das heißt, sie interagieren mit Menschen, Kollektiven und Gesellschaften. Und darin liegt auch das Potenzial, denn ihre Expertise liegt in einem Bereich, in dem Menschen grundsätzlich nicht gut ausgestattet sind: der Probabilistik. Während Algorithmen darauf ausgelegt sind, Wahrscheinlichkeiten zu berechnen, sind Menschen, so Jaume-Palasi, sehr gut darin, Dinge zu kontextualisieren. Das versteht wiederum die KI nicht und so schließt sich der Kreis. Allerdings besteht eine Diskrepanz zwischen der Wahrnehmung dessen, was Algorithmen leisten und dem, was sie tatsächlich machen. Die stark auf das Individuum ausgerichtete westliche Demokratie steht hier in einem Widerspruch zur auf der Erfassung von Kollektiven erzogenen KI. Denn was als individualisierte „Peronalisierung“ verkauft (und inzwischen auch vielerorts gefürchtet) wird ist eine „semantische Täuschung“; in der Interaktion mit der KI erhalte ich keineswegs eine individualisierte, sondern eine standardisierte Information. Ein Algorithmus kennt das Individuum nicht, es kennt nur den Durchschnitt, die Muster, die Mehrheit, die Wiederholung und fasst auf diese Weise viele Einzelne in mikrogranulare Kollektive zusammen. (Genau so wurden im Übrigen von Cambridge Analytica jene paar Prozent sogenannter „swing-Voters“ in „swing-states“ identifiziert und gezielt mit republikanischer Propaganda bombardiert. Das hat für den Sieg ohne „popular vote“ gereicht.) Die Krux am Durchschnitt ist jedoch, dass es für ihn oftmals keine Realpräsenz gibt: Welche Frau٭ in Deutschland hat schon 1,57 Kinder? Deshalb ist es wichtig zu verstehen, was ein Durchschnitt im jeweiligen Kontext bedeutet. Algorithmen und Künstliche Intelligenz sind letztlich ein Stück Kultur, „eine andere Sprache, mit der die Menschen die Welt kartographieren“. Es verwundert also nicht, dass alle Biases, Vorurteile und Diskriminierungen auch im virtuellen Raum reproduziert werden. Verschleiert wird dies im eklatanten Missverstehen von Algorithmen als Katalysatoren objektiver Wahrheit, die ohne Kontext existieren können. Wie im Raum abseits des Internets, ist diese Vorstellung ein Phantasma. Wie aber kann die soziale Diskriminierung in algorithmischen Systemen erfasst und rechtlich eingeordnet werden? Das Pochen auf die Grundrechte, so Jaume-Palasi, greift nicht, da sie sich als Individualrechte verstehen, wir es aber hier mit einer kollektivistischen Technologie zu tun haben. „Wir haben eine Technologie, die das Individuum nicht kennt und eine normative Ordnung, die nur das Individuelle kennt.” Genau diese Lücke wird in der Debatte um die soziale Verantwortung von KI immer weiter amplifiziert. Überprüft man die Technologie nur darauf, inwiefern sie die Grundrechte (also ein der Individualtheorie verschriebenes Rechtssystem) widerspiegeln, verfehlt man das Thema – und die mögliche Chance eines diskriminierungsfreien Raums – total. Lorena Jaume-Palasi reiht sich in die lange Reige feministischer, postkolonialer, antirassistischer Denker٭innen ein, wenn sie einmal mehr für Kontext plädiert. Nicht auf Grundrechte soll KI daher überprüft werden, sondern auf soziale, auf kontextuelle Werte. Grundsätze, die als Maßstäbe der Raumordnung auch unseren demokratischen Zusammenschlüssen im analogen Raum vertraut sind, die aber weiterentwickelt und neu hinterfragt werden müssen. Dabei benennt Jaume-Palasi sieben an der Zahl: 1. Vielfalt 2. Nachhaltigkeit 3. Fairer Zugang zu Daseinsvorsorge 4. Polyzentrismus 5. Stabile ökonomische, kulturelle, soziale (etc.) Strukturen 6. Sicherheit 7. Sozialer Zusammenhalt Dazu können wir nur sagen: ja, bitte. Und: Jaume-Palasi for President.

Graduate Show 2025: Don't stop me now

Graduate Show 2025: Don't stop me now

Long days, lots to do

Long days, lots to do

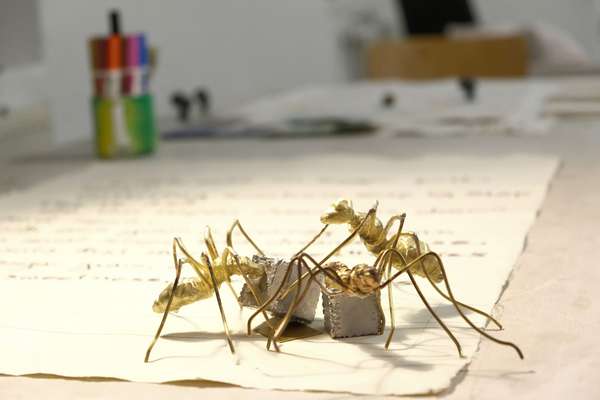

Cine*Ami*es

Cine*Ami*es

Redesign Democracy – competition for the ballot box of the democratic future

Redesign Democracy – competition for the ballot box of the democratic future

Art in public space

Art in public space

How to apply: study at HFBK Hamburg

How to apply: study at HFBK Hamburg

Annual Exhibition 2025 at the HFBK Hamburg

Annual Exhibition 2025 at the HFBK Hamburg

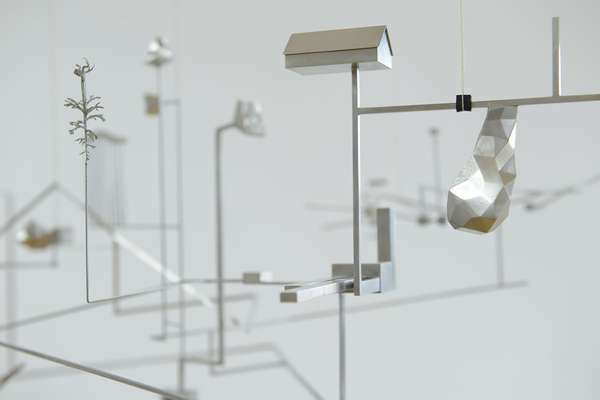

The Elephant in The Room – Sculpture today

The Elephant in The Room – Sculpture today

Hiscox Art Prize 2024

Hiscox Art Prize 2024

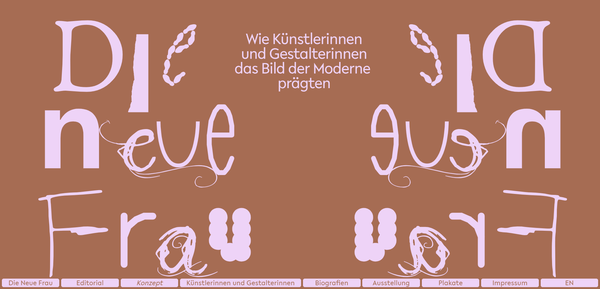

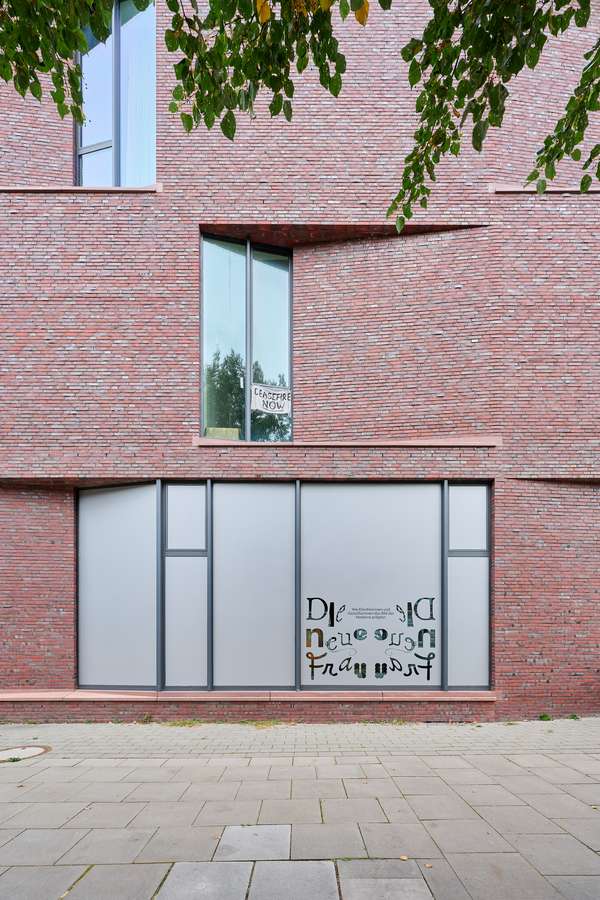

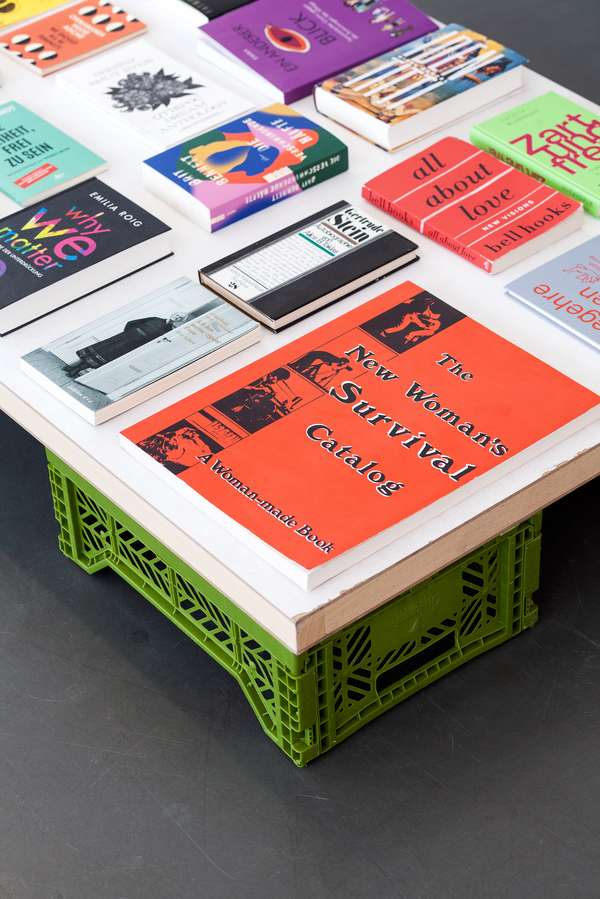

The New Woman

The New Woman

Doing a PhD at the HFBK Hamburg

Doing a PhD at the HFBK Hamburg

Graduate Show 2024 - Letting Go

Graduate Show 2024 - Letting Go

Finkenwerder Art Prize 2024

Finkenwerder Art Prize 2024

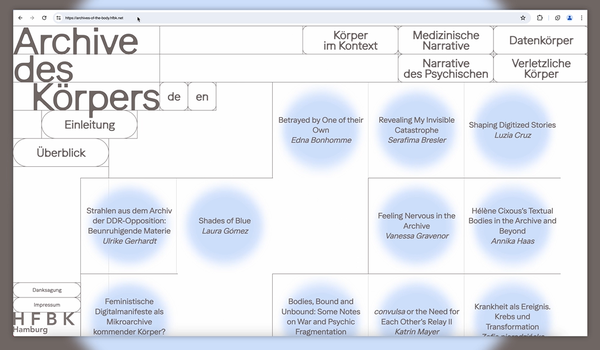

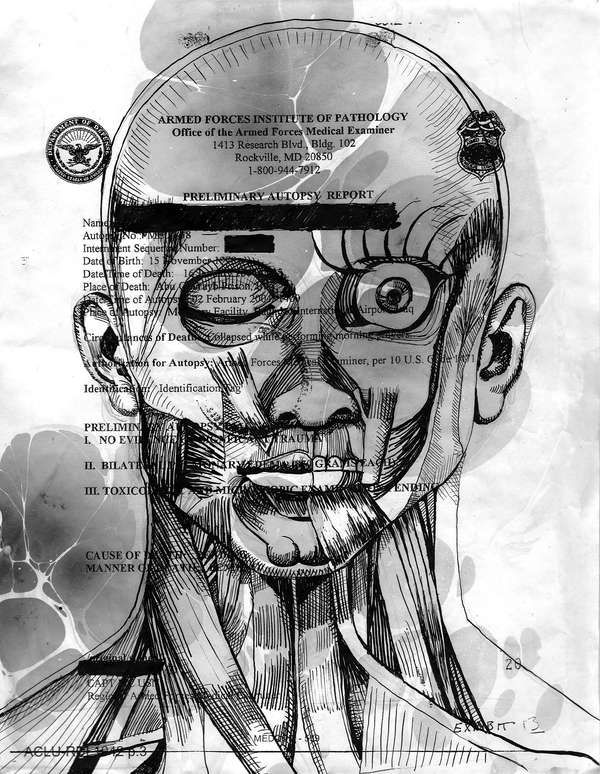

Archives of the Body - The Body in Archiving

Archives of the Body - The Body in Archiving

New partnership with the School of Arts at the University of Haifa

New partnership with the School of Arts at the University of Haifa

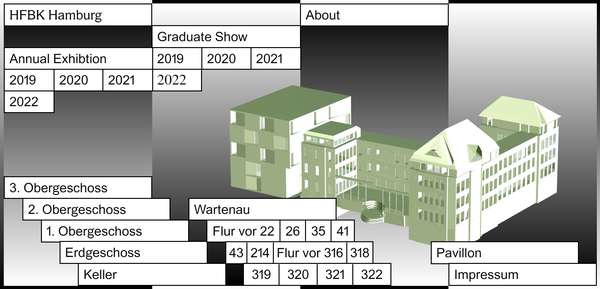

Annual Exhibition 2024 at the HFBK Hamburg

Annual Exhibition 2024 at the HFBK Hamburg

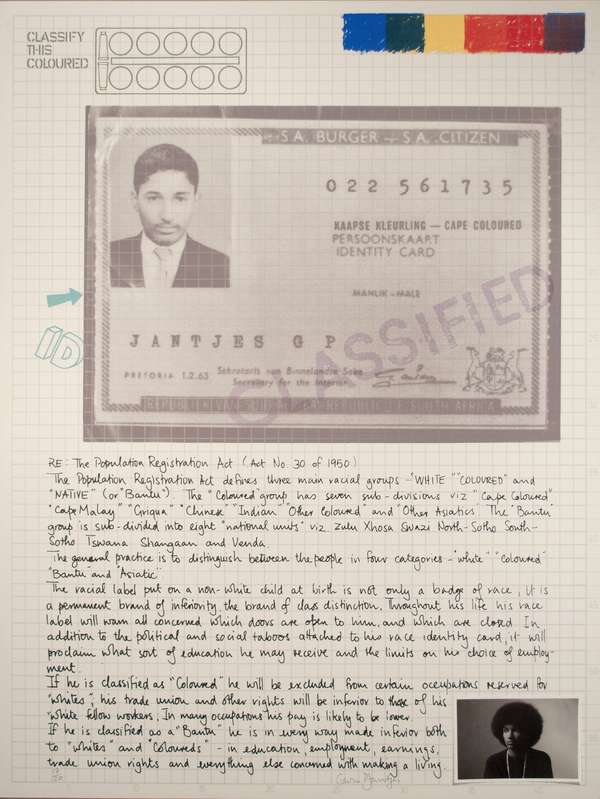

(Ex)Changes of / in Art

(Ex)Changes of / in Art

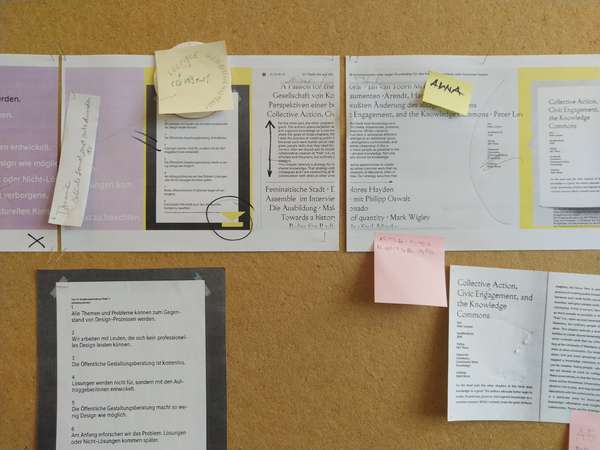

Extended Libraries

Extended Libraries

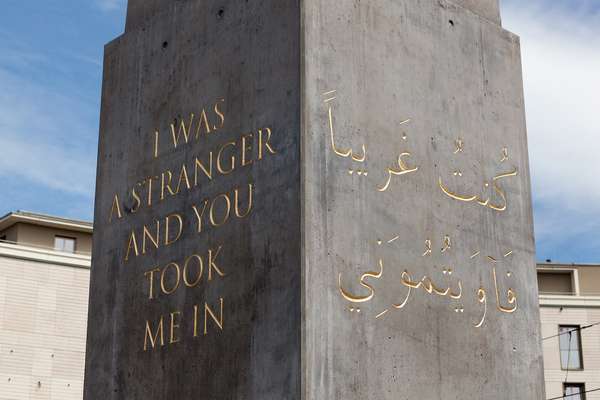

And Still I Rise

And Still I Rise

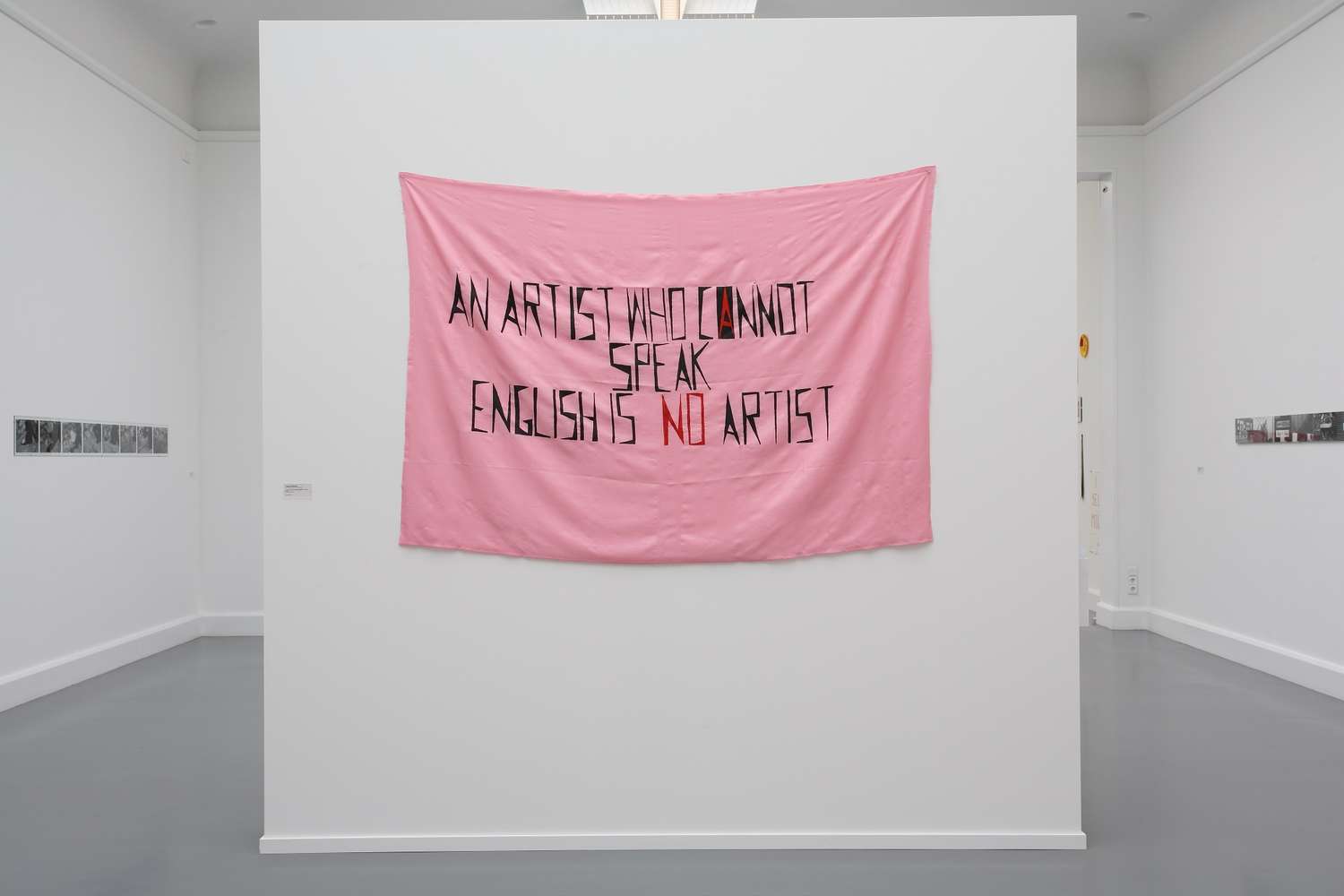

Let's talk about language

Let's talk about language

Graduate Show 2023: Unfinished Business

Graduate Show 2023: Unfinished Business

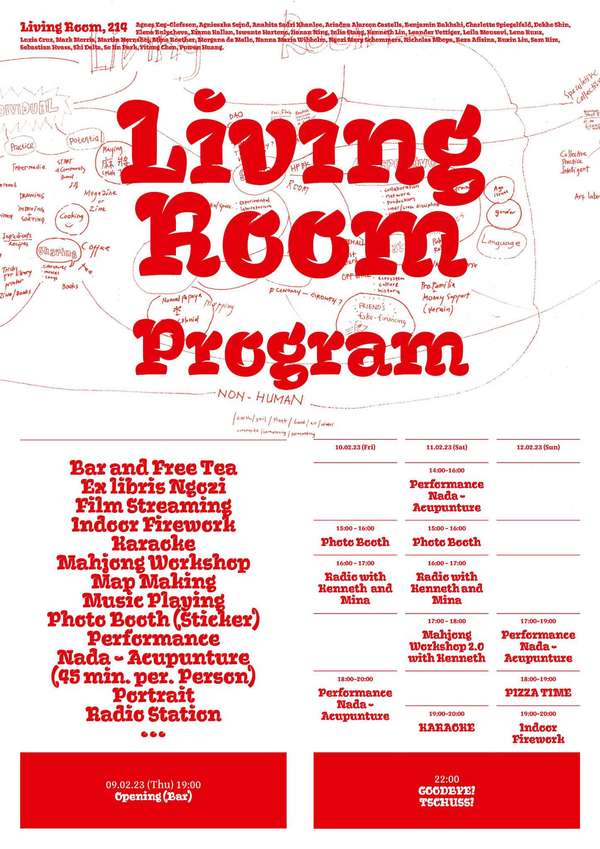

Let`s work together

Let`s work together

Annual Exhibition 2023 at HFBK Hamburg

Annual Exhibition 2023 at HFBK Hamburg

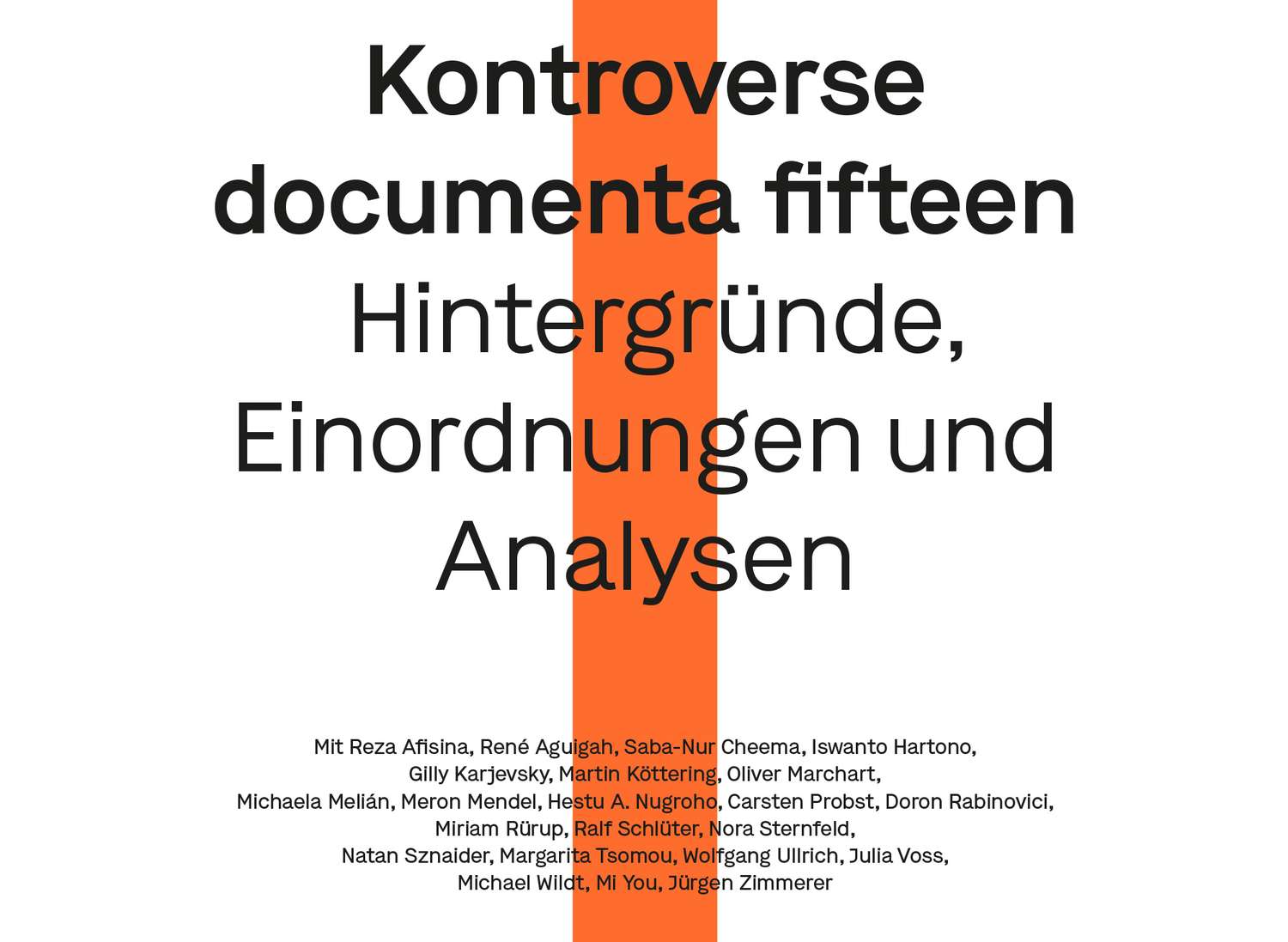

Symposium: Controversy over documenta fifteen

Symposium: Controversy over documenta fifteen

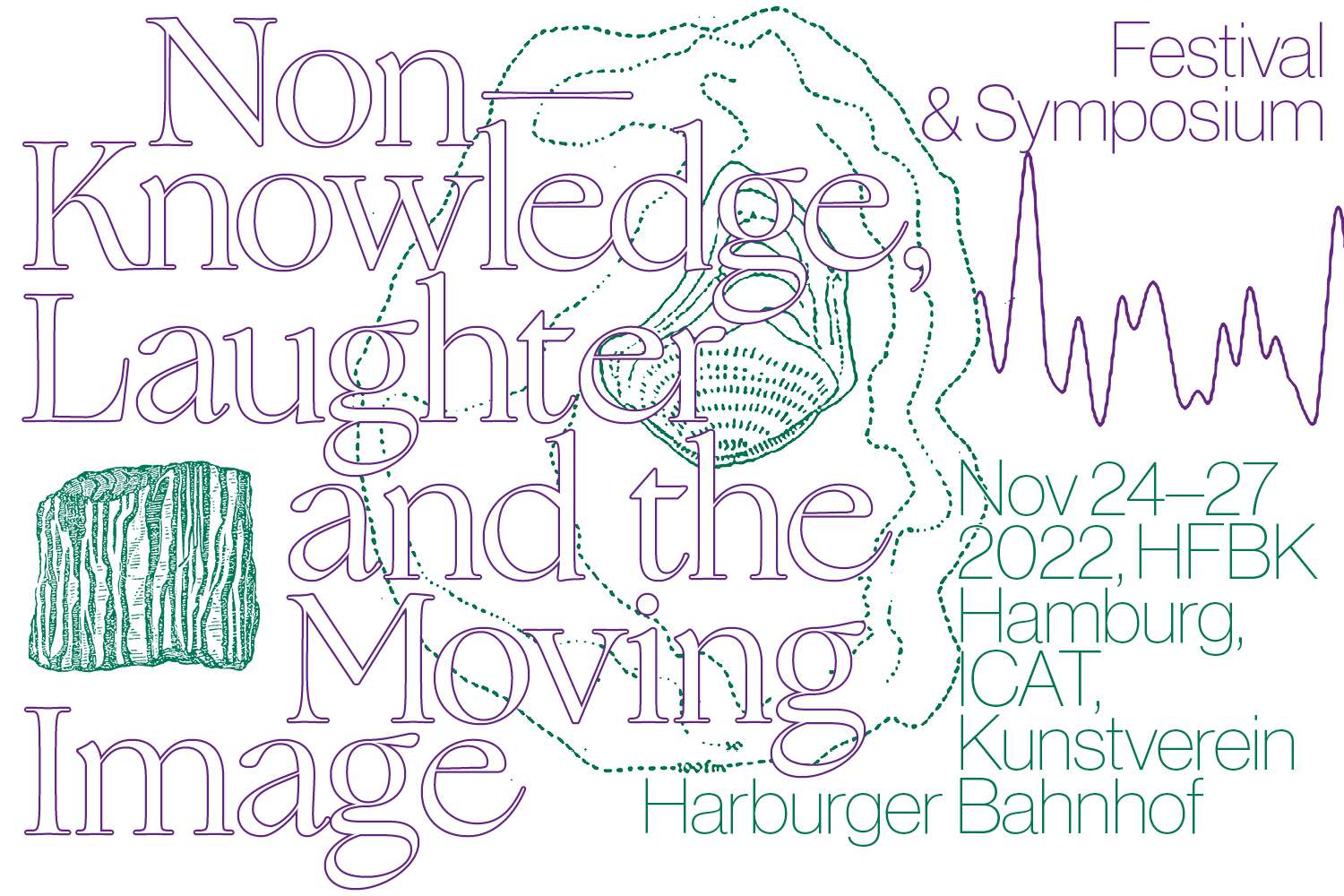

Festival and Symposium: Non-Knowledge, Laughter and the Moving Image

Festival and Symposium: Non-Knowledge, Laughter and the Moving Image

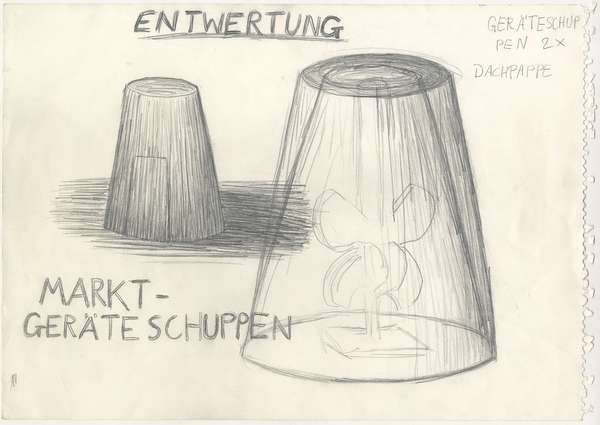

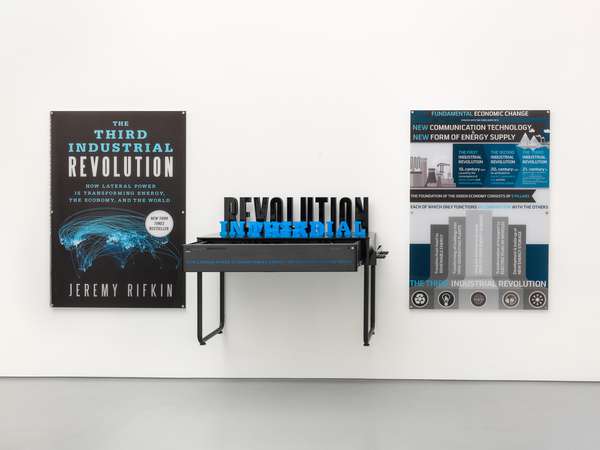

Solo exhibition by Konstantin Grcic

Solo exhibition by Konstantin Grcic

Art and war

Art and war

Graduate Show 2022: We’ve Only Just Begun

Graduate Show 2022: We’ve Only Just Begun

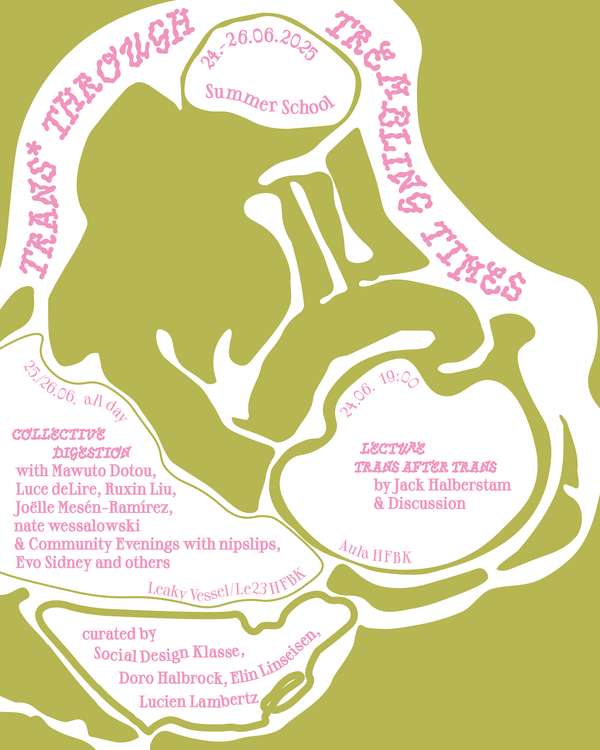

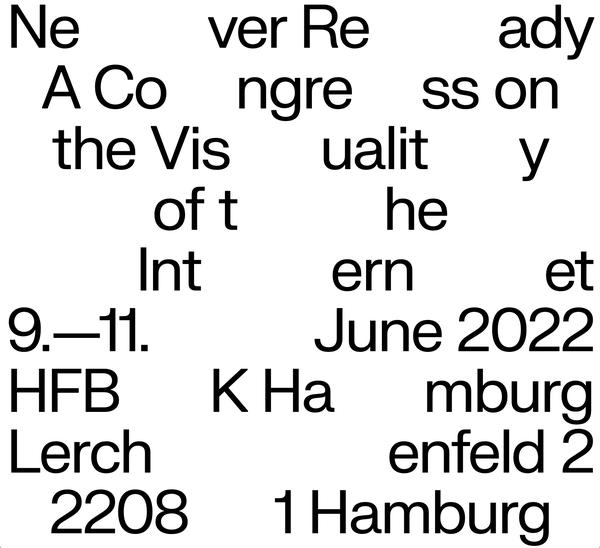

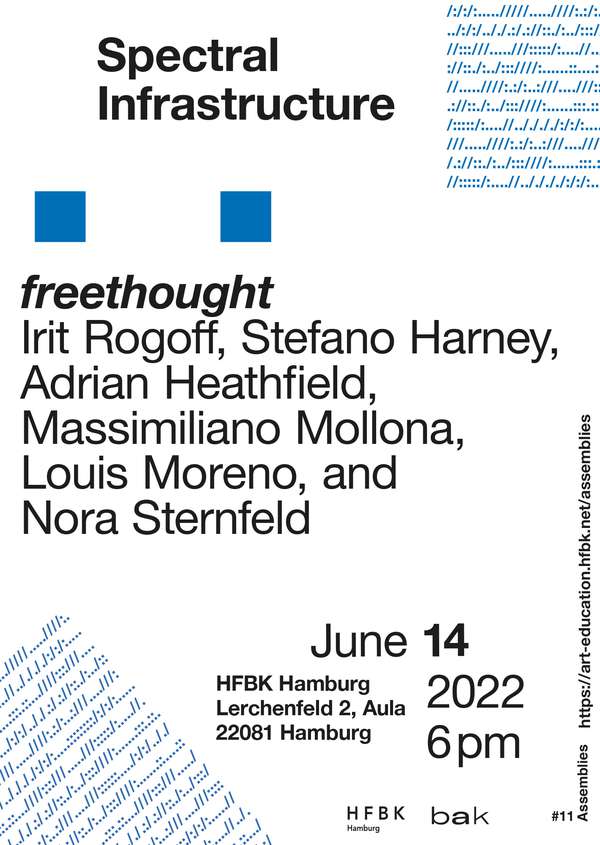

June is full of art and theory

June is full of art and theory

Finkenwerder Art Prize 2022

Finkenwerder Art Prize 2022

Nachhaltigkeit im Kontext von Kunst und Kunsthochschule

Nachhaltigkeit im Kontext von Kunst und Kunsthochschule

Raum für die Kunst

Raum für die Kunst

Annual Exhibition 2022 at the HFBK

Annual Exhibition 2022 at the HFBK

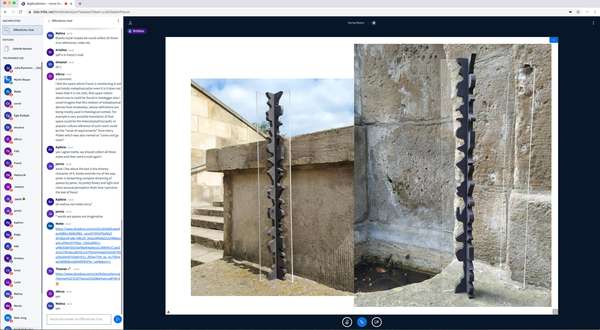

Conference: Counter-Monuments and Para-Monuments.

Conference: Counter-Monuments and Para-Monuments.

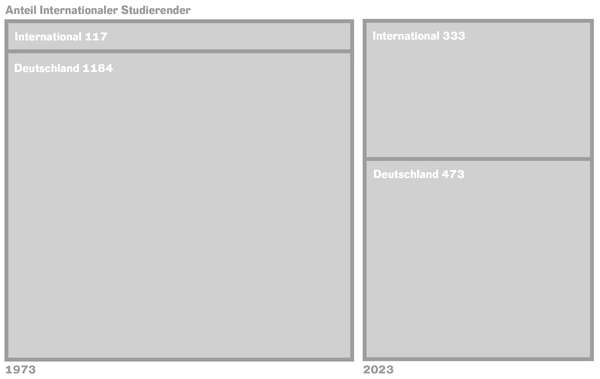

Diversity

Diversity

Live und in Farbe: die ASA Open Studios im Juni 2021

Live und in Farbe: die ASA Open Studios im Juni 2021

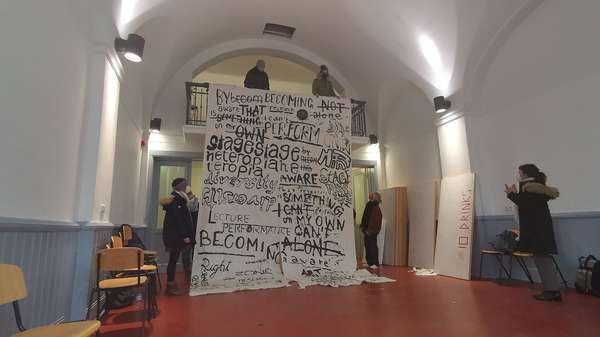

Unlearning: Wartenau Assemblies

Unlearning: Wartenau Assemblies

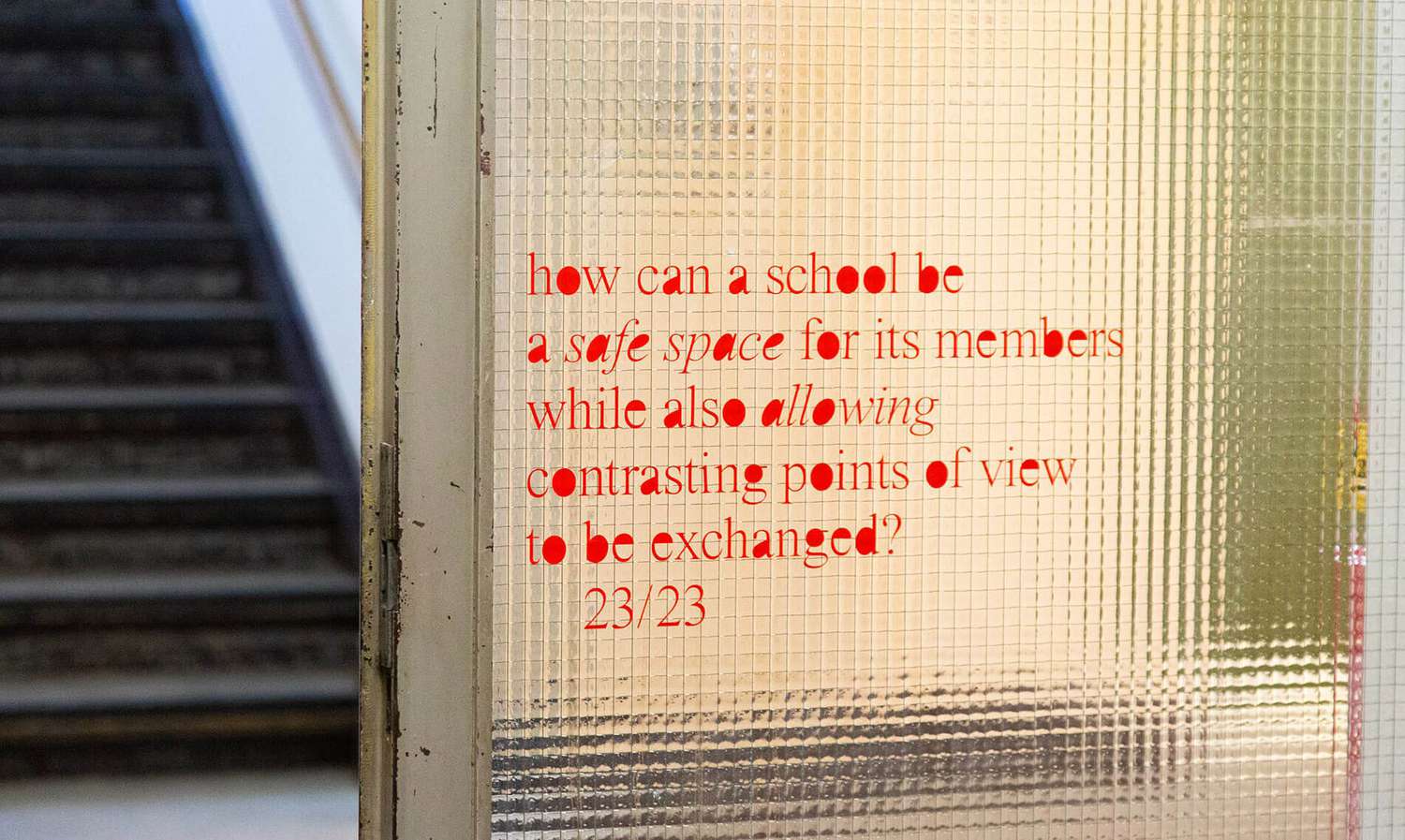

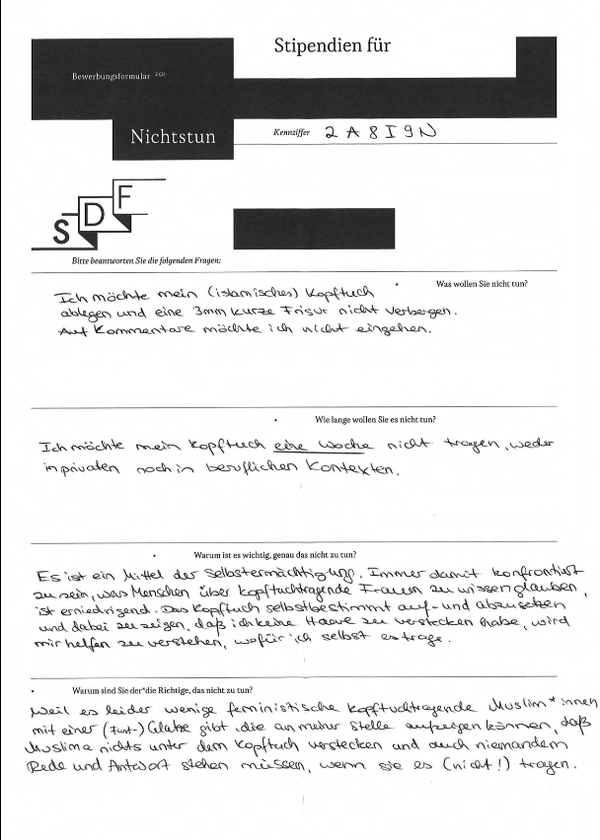

School of No Consequences

School of No Consequences

Annual Exhibition 2021 at the HFBK

Annual Exhibition 2021 at the HFBK

Semestereröffnung und Hiscox-Preisverleihung 2020

Semestereröffnung und Hiscox-Preisverleihung 2020

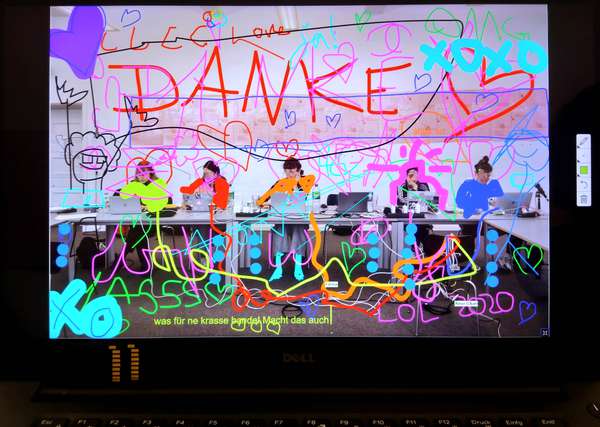

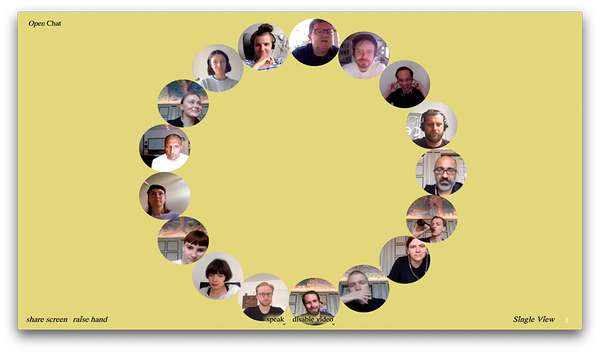

Teaching Art Online at the HFBK

Teaching Art Online at the HFBK

HFBK Graduate Survey

HFBK Graduate Survey

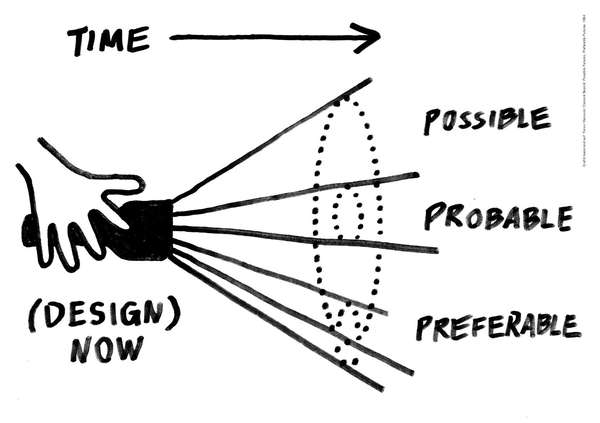

How political is Social Design?

How political is Social Design?